KI im KMU: So nutzt du ChatGPT & Co., ohne einen Datenschutz-Albtraum zu erleben

Dilemma

Der Einsatz von künstlicher Intelligenz ist aus dem Entwicklungs- und Unternehmensalltag kaum noch wegzudenken. KI ermöglicht eine extreme Effizienzsteigerung, das ist unbestritten. Doch was passiert, wenn man beim Debuggen schnell einen Code-Block in ein KI-System kopiert? Schneller, als man blinzeln kann, landet der API- oder SSH-Key auf einem Server in den USA. Somit hat man Innerhalb kürzester Zeit ein riesiges Sicherheitsrisiko geschaffen.

Noch schlimmer wird es, wenn zusätzlich Log-Files in diese Systeme hochgeladen werden. Diese können nicht nur systemkritische Passwörter, sondern auch sensible Kundendaten enthalten. Damit hat man nicht nur ein Sicherheits-, sondern auch ein handfestes rechtliches Problem. Doch wie kann man KI nutzen, ohne ungewollt Daten zu leaken?

Mit dieser Frage habe ich mich über Wochen hinweg intensiv beschäftigt. Für meine interdisziplinäre Projektarbeit (IDPA) habe ich analysiert, wie Unternehmen externe und interne KI-Systeme datenschutzkonform nutzen können. Da die wenigsten KMU über eine eigene Rechtsabteilung verfügen, habe ich die wichtigsten Erkenntnisse meiner Arbeit in diesem Blogbeitrag zusammengefasst. Hier erfährst du, worauf du achten musst und wie du den Entwickleralltag rechtssicher gestaltest.

Weil die Praxis am Ende wichtiger ist als die Theorie, habe ich für diesen Beitrag Bert Hofmänner, CEO der Softwarefirma HNM, angefragt. Er hat meine Arbeit mitbewertet und teilt im Anschluss seine Erfahrungen, wie er diese Prinzipien im Projektalltag umgesetzt hat.

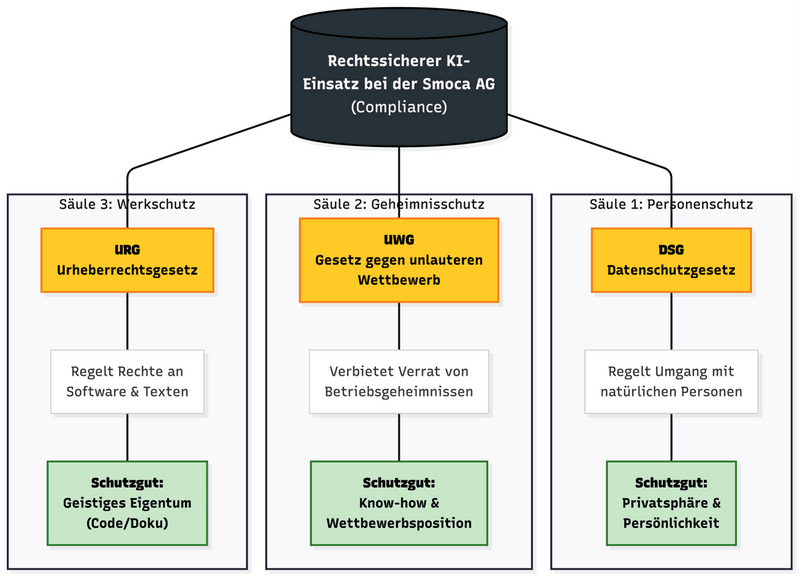

Der rechtliche Rahmen: Das Drei-Säulen-Modell

Oft wird beim Thema KI nur an den Datenschutz gedacht. Der rechtliche Rahmen für den Einsatz von KI-Systemen in der Schweiz stützt sich jedoch auf drei zentrale Säulen, die alle beachtet werden müssen:

Säule 1: Das Datenschutzgesetz (DSG)

Das DSG schützt die Privatsphäre und die Daten natürlicher Personen. Dabei geht es nicht nur um offensichtliche Angaben wie Namen. Auch indirekte Identifikatoren gelten als Personendaten, wie zum Beispiel Kundennummern, User-IDs oder IP-Adressen. Sobald solche Daten in eine externe Cloud-KI eingegeben werden, erfolgt eine rechtlich relevante Datenbekanntgabe an Dritte.

Quelle: Datenschutzgesetz

Säule 2: Das Wettbewerbsrecht (UWG)

Das Gesetz gegen den unlauteren Wettbewerb (UWG) schützt das Know-how und die Wettbewerbsposition eines Unternehmens. Es verbietet die unbefugte Weitergabe von Geschäfts- und Betriebsgeheimnissen. Hier wird es für Entwickler kritisch. Zu diesen Geheimnissen zählen nicht öffentlicher Quellcode, interne Abläufe oder Kundenlisten. Wer beim Debugging unbedacht einen Codeblock inklusive API-Keys kopiert, gibt diese Geheimnisse unter Umständen preis.

Quelle: Wettbewerbsgesetz

Säule 3: Das Urheberrecht (URG)

Das Urheberrechtsgesetz (URG) regelt die Rechte an geistigem Eigentum. Individuelle geistige Schöpfungen wie Programmiercode oder detaillierte technische Dokumentationen sind gesetzlich geschützt. Wenn Mitarbeitende geschützten Code an eine externe KI übermitteln, machen sie dieses Werk unberechtigt Dritten zugänglich, was schnell zu einer Urheberrechtsverletzung führen kann.

Doch Vorsicht, das Risiko besteht in beide Richtungen: Wenn dir die KI als Antwort fremden, urheberrechtlich geschützten Code ausgibt und du diesen ungeprüft in dein eigenes Projekt übernimmst, begehst du ebenfalls eine Urheberrechtsverletzung.

Quelle: Urheberrecht

Was machen OpenAI, Google und Co. eigentlich mit unseren Daten?

Bevor ich die Lösung präsentiere, muss ich kurz klären, was bei den Cloud-Anbietern passiert. Was geschieht mit den Daten, die wir in einen Chatbot eingeben? Die Analyse der Datenschutzrichtlinien hat gezeigt, dass grundsätzlich zwischen zwei Verarbeitungsschritten unterschieden werden muss:

Die Antwortgenerierung und Speicherung

Zunächst wird die Eingabe vom Anbieter verarbeitet, um eine Antwort zu generieren. Zusätzlich werden die Inhalte und Metadaten gespeichert, um den Dienst bereitzustellen und Missbrauch zu erkennen. Das ist zwar aus technischer Sicht normal, bedeutet jedoch rechtlich bereits, dass die Daten dein Unternehmen verlassen haben.

Das Modelltraining

Hier wird es für KMU gefährlich. Anbieter wie OpenAI und Google nutzen die Eingaben bei Standardversionen grundsätzlich zur Verbesserung ihrer Modelle. Somit fliesst Firmenwissen irreversibel in die KI ein. Die gute Nachricht: Über die Einstellungen bieten diese Anbieter sogenannte Opt-out-Möglichkeiten an, mit denen sich die Trainingsnutzung manuell deaktivieren lässt.

Einen entscheidenden Unterschied gibt es bei Unternehmenslösungen und API-Produkten. Bei Anbietern wie OpenAI, Google und Anthropic ist vertraglich zugesichert, dass Kundendaten standardmässig nicht zum Training der Modelle verwendet werden. Wer als Unternehmen also eine Business-Lizenz bucht oder die Tools über eine API anbindet, umgeht das Trainingsrisiko von vornherein.

Die unsichtbare Gefahr

Während das Datenschutzgesetz uns bei Personendaten in die Pflicht nimmt, geht es bei internen Passwörtern, SSH-Keys oder API-Tokens um den Schutz der eigenen Infrastruktur. Es wurde bereits erwähnt, dass diese Daten Geschäftsgeheimnisse verletzen können. Sie fallen jedoch nicht zwingend darunter und haben in externen KI-Modellen absolut nichts verloren – unabhängig davon, ob das Training der KI deaktiviert ist oder nicht. Wenn eine dritte Partei Zugriff darauf erhält, kann sie auf kritische Systeme zugreifen.

Versteckte Gefahren in JSON-Files und Dumps

Der Umgang mit strukturierten Datensätzen, wie sie häufig im JSON-Format vorliegen, ist im Entwickleralltag besonders tückisch. Oft enthalten ein harmlos wirkender Test-Dump oder eine API-Antwort versteckte personenbezogene Daten, beispielsweise Kundennummern, interne User-IDs, E-Mail-Adressen in Testdaten oder Zeitstempel von Nutzeraktionen. Diese werden beim schnellen Kopieren leicht übersehen. In Konfigurationsdateien oder JSON-Objekten verbergen sich zudem häufig sicherheitskritische Authentifizierungsdaten wie API-Keys, Bearer-Tokens oder Passwörter. Die unbedachte Eingabe solcher Dateien in ein KI-System stellt ein massives Sicherheitsrisiko dar.

Die Lösung: Lokale KI-Modelle

Wie können wir also Code debuggen, der solche Secrets oder Kundendaten enthält, ohne ein Risiko einzugehen? Die Antwort lautet: selbst gehostete, lokale KI-Modelle.

Im Gegensatz zu Cloud-Modellen wie ChatGPT, bei denen die Eingaben an externe Anbieter übermittelt werden, verbleiben die Daten bei lokalen Modellen vollständig im eigenen Unternehmen.

Das bedeutet, dass sensible Informationen zu keinem Zeitpunkt das geschützte interne Netzwerk verlassen. Tools wie Ollama oder Modelle wie Qwen erlauben es, leistungsstarke KIs direkt auf dem eigenen Rechner oder einem Firmen-Server auszuführen. Dadurch findet rechtlich gesehen keine Datenbekanntgabe an Dritte statt. Das Unternehmen behält die volle Kontrolle über die gespeicherten Informationen und verhindert die ungewollte Offenlegung von Infrastruktur-Secrets.

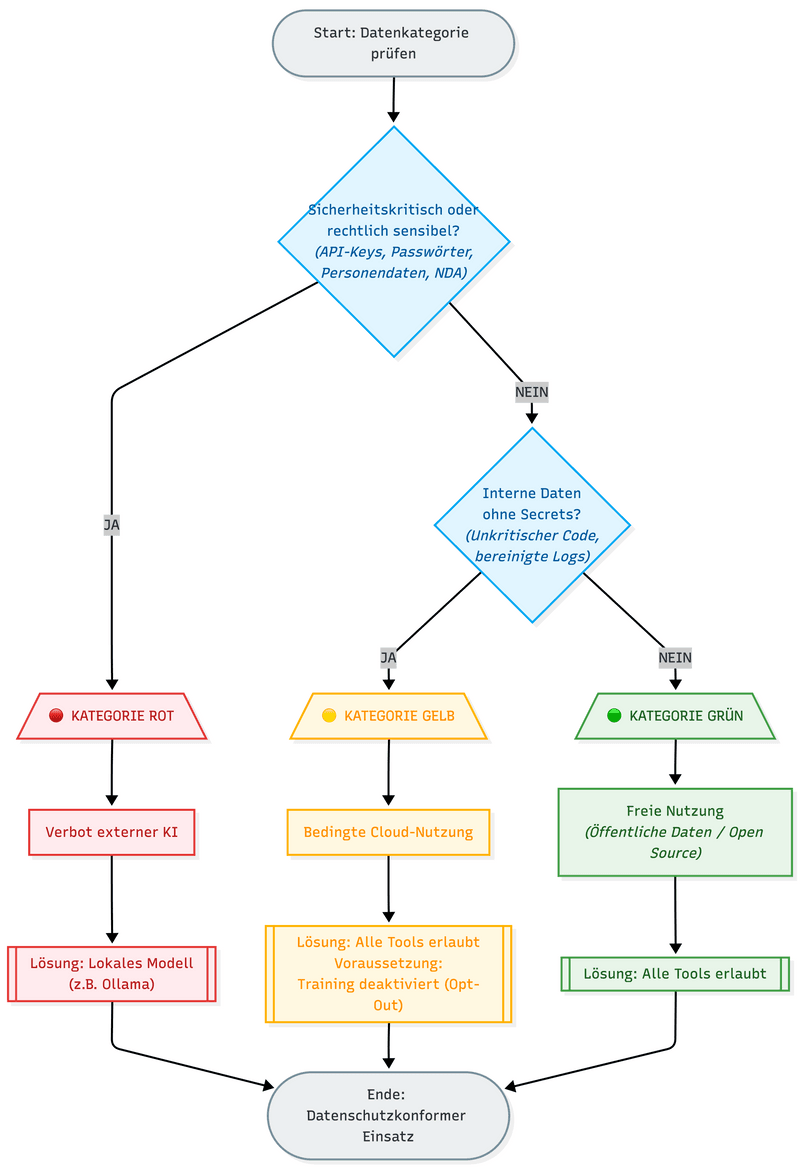

Ampel-System

Um diese Risiken einfach zu minimieren, habe ich in meiner Arbeit ein Ampelsystem entwickelt, das einen schnellen Überblick darüber gibt, welche Daten an welche KI weitergegeben werden dürfen.Im Ampelsystem werden die Daten in den folgenden 3 Kategorien Aufgeteilt.

🔴 Kategorie Rot

Hierunter fallen alle hochsensiblen Informationen. Dazu gehören Personendaten, Zugangsdaten wie API-Keys und Passwörter, Produktionsdatenbanken sowie Code, der strengen Geheimhaltungsverträgen (NDAs) unterliegt. Solche Daten dürfen niemals an externe Cloud-Anbieter gesendet werden, hierfür müssen zwingend interne oder lokale Modelle genutzt werden.

🟡 Kategorie Gelb

Dies umfasst internen Programmcode ohne kritische Business-Logik, anonymisierte Fehlermeldungen und generische Texte. Die Nutzung von Cloud-Diensten ist hier unter der strikten technischen Voraussetzung erlaubt, dass das Training mit diesen Daten in den Einstellungen deaktiviert ist (Opt-Out).

🟢 Kategorie Grün

In diese Kategorie fallen öffentliche Informationen, Open-Source-Code oder Marketingtexte ohne Personenbezug. Hier können sämtliche verfügbaren KI-Tools zur Effizienzsteigerung uneingeschränkt genutzt werden.

Der Realitäts-Check: KI-Sicherheit im echten KMU-Alltag

Theorie ist gut, aber wie sieht es in der Praxis aus, wenn Deadlines drücken? Ich habe mit Bert gesprochen. Er ist CEO der Softwarefirma HNM und kümmert sich intern um die sichere KI-Nutzung.

Lukas: "Ich habe für meine Arbeit das Ampel-System entwickelt. Wie habt ihr dieses Konzept konkret in euren Arbeitsalltag integriert? Gab es 'Aha-Momente', als das Team gemerkt hat, was alles streng verboten ist?"

Bert: "Wir nutzen zwar nicht explizit das visuelle Ampelsystem, haben aber auf dieser Basis ein klares ‚Set of Rules‘ definiert. Aha-Momente oder böse Überraschungen gab es bei uns kaum, und das hat einen einfachen Grund: Wir haben das Regelwerk eingeführt, noch bevor die Mitarbeitenden überhaupt die Möglichkeit hatten, sensible Daten oder echten Code gegenüber KI-Services zu exponieren."

Lukas: "Für hochsensible Daten empfehle ich lokale KI-Modelle. Wie praktikabel ist dieser Ansatz unter Projektstress und wo seht ihr als KMU die grössten Hürden?"

Bert: "Wir setzen lokale LLMs noch nicht fest im produktiven Einsatz ein. Aktuell experimentieren wir mit Modellen wie Gemma 4, das einen hervorragenden ersten Eindruck macht. Ich gehe davon aus, dass diese lokalen Modelle schnell grosse Fortschritte machen werden. Die grösste Herausforderung für uns als KMU ist aktuell, die nötige lokale Infrastruktur bereitzustellen. Richtig cool wäre es, ein System wie Ollama fest im Firmennetzwerk zu haben. Solange wir das noch nicht haben, lösen wir das Problem pragmatisch: Wir schicken schlichtweg keine grösseren Code-Stücke an Cloud-LLMs."

Lukas: "Was ist dein wichtigster Ratschlag an andere KMU-Geschäftsführer?"

Bert: "Das Bewusstsein muss zwingend vorhanden sein! Deine Arbeit hat uns dabei sehr geholfen, da sie ganz klar definiert, welche Teile von Code oder Daten zwingend geschützt werden müssen. Wenn dieses Fundament steht, geht es vor allem darum, die Mitarbeitenden konsequent für diese Themen zu sensibilisieren."

Bewusstsein schlägt Budget

Berts Aussagen bringen es auf den Punkt: Um Datenschutz zu betreiben, braucht man nicht sofort ein gigantisches Budget für interne Server. Der wichtigste Schritt ist die Sensibilisierung des Teams. Wer weiss, was ein "Secret" ist und dass Cloud-KI mit unseren Daten trainiert wird, schützt das Unternehmen bereits vor den grössten Risiken.

Haltet euch an den "Local-First"-Ansatz für sensible Daten und nutzt konsequent den Opt-out-Button für alles andere.

Diese Prinzipien sind derzeit hochaktuell. Doch wie bei der Technologie selbst kann sich auch die Rechtslage schnell ändern. Das zeigt der aktuelle Auftrag, den der Bundesrat dem EJPD (Eidgenössisches Justiz- und Polizeidepartement) erteilt hat. Bis Ende 2026 soll eine Vernehmlassungsvorlage für neue Regeln zur Nutzung von KI ausgearbeitet werden. Es kann sich in den kommenden Jahren hinsichtlich eines Schweizer KI-Gesetzes also noch einiges ändern. Dennoch bin ich fest davon überzeugt, dass die Grundprinzipien meiner Arbeit, insbesondere der Schutz von Personendaten und Geschäftsgeheimnissen, auch in Zukunft der wichtigste Massstab für KMU bleiben werden.

Quelle: Schweizer KI-Gesetz

Du willst tiefer in die rechtlichen Details oder die technischen Setups eintauchen? Meine vollständige Projektarbeit (IDPA) zum Thema "Datenschutzkonformer Einsatz von KI-Modellen" kannst du hier lesen: pdf